Il 2 febbraio 2025 ha segnato un punto di svolta per l’uso dell’intelligenza artificiale nell’Unione Europea: con l’entrata in vigore delle disposizioni del Regolamento 1689/2024 (AI Act) sui sistemi di IA ad alto rischio, il quadro normativo si evolve, imponendo nuovi obblighi e ridefinendo il rapporto tra tecnologia e diritto. Questo cambiamento non riguarda solo le imprese e i loro obblighi di compliance (che abbiamo già approfondito in un recente articolo), ma investe direttamente il settore forense, chiamato a confrontarsi con regole più stringenti e nuove responsabilità nella valutazione e gestione dei sistemi di IA.

Intelligenza artificiale per Avvocati: le opportunità per la professione legale

L’adozione dell’Intelligenza Artificiale nell’ambito legale ha rappresentato, negli ultimi anni, un significativo passo verso la trasformazione digitale degli studi legali. Da strumento per automatizzare compiti ripetitivi, l’AI è divenuta un alleato nella creazione di soluzioni innovative per affrontare le sfide giuridiche moderne.

L’adozione di strumenti AI consente agli avvocati di ottimizzare la gestione delle pratiche, ridurre i tempi di ricerca e analisi e migliorare la qualità dei servizi offerti. Tra i casi d’uso più comuni troviamo:

- Automazione della documentazione legale: l’AI permette di analizzare e revisionare contratti e documenti legali, identificando errori e proponendo modifiche.

- Ricerca giuridica avanzata: sistemi AI specializzati nell’analisi dei precedenti giudiziari e delle normative, che facilitano l’individuazione delle risposte legali più pertinenti per ciascun caso.

- Analisi predittiva: l’AI è in grado di prevedere gli esiti legali sulla base di dati storici e precedenti, supportando il processo decisionale per le cause in corso.

- Sistemi conversazionali: assistenti virtuali che permettono agli avvocati di interagire facilmente con clienti e colleghi, risolvendo dubbi legali attraverso un’interfaccia naturale e intuitiva.

Questi strumenti non solo aumentano l’efficienza operativa degli studi, ma permettono anche una personalizzazione automatizzata delle strategie legali, adattando documenti e risposte alle specifiche richieste di ogni cliente e caso.

AI Act: cosa cambia dal 2 febbraio 2025

Dal 2 febbraio 2025, l’Unione Europea ha compiuto un passo decisivo nella regolamentazione dell’intelligenza artificiale con l’applicazione delle prime disposizioni vincolanti dell’AI Act (Regolamento UE 2024/1689). Questa data ha segnato l’entrata in vigore del divieto su alcuni sistemi di IA considerati a rischio inaccettabile, ritenuti pericolosi per i diritti fondamentali e la sicurezza delle persone.

L’AI Act adotta un approccio basato sul rischio, classificando i sistemi di intelligenza artificiale in quattro categorie:

- Rischio inaccettabile: tecnologie vietate del tutto.

- Alto rischio: soggette a rigide regolamentazioni e controlli.

- Rischio limitato: obbligo di trasparenza, ma con vincoli meno stringenti.

- Rischio minimo: nessuna restrizione particolare.

I rischi e le aree sensibili: cosa evitare

Nonostante le potenzialità, l’uso dell’AI porta con sé dei rischi. La gestione di dati sensibili e la necessità di garantire che i sistemi di AI siano utilizzati in modo conforme alle normative europee richiedono infatti una particolare attenzione. In particolare, l’AI Act stabilisce delle categorie di rischio, mettendo in evidenza i sistemi considerati “ad alto rischio” che devono essere regolati in maniera rigorosa. Le attività vietate, che gli avvocati devono assolutamente evitare, includono:

- Sistemi di scoring sociale: tecnologie che utilizzano i comportamenti sociali per classificare gli individui, come nel caso del controverso sistema di “credit score” cinese. Tali strumenti, seppur potenzialmente utili per alcune applicazioni, sono vietati poiché rischiano di violare i diritti fondamentali delle persone.

- Manipolazione del comportamento umano: l’uso di AI per influenzare o modificare il comportamento delle persone senza il loro consenso esplicito, soprattutto in ambito commerciale o nelle interazioni sociali, è severamente vietato.

- Riconoscimento biometrico in tempo reale negli spazi pubblici: sebbene ci siano eccezioni, come la ricerca di persone scomparse o la prevenzione di atti terroristici, l’uso della tecnologia per identificare persone in tempo reale nei luoghi pubblici è vietato.

Conclusioni: equilibrio tra innovazione e responsabilità

L’integrazione dell’Intelligenza Artificiale nella professione legale rappresenta una delle più grandi sfide e opportunità del nostro tempo. Se da un lato l’AI offre un’enorme potenzialità in termini di efficienza e innovazione, dall’altro impone una responsabilità senza precedenti, soprattutto in relazione alla protezione dei diritti fondamentali e alla sicurezza dei dati. L’adozione di strumenti AI dovrà tuttavia essere accompagnata da un’attenta osservanza delle normative stabilite dall’AI Act, in modo da garantire che l’evoluzione della professione legale avvenga nel rispetto dei principi di etica e giustizia.

Formazione in materia

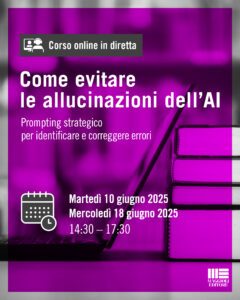

L’intelligenza artificiale generativa sta rivoluzionando anche il mondo giuridico, offrendo strumenti potenti ma non privi di rischi. Tra questi, il più insidioso è rappresentato dalle cosiddette “allucinazioni”, ovvero risposte inventate, non supportate da fonti, che possono compromettere la qualità del lavoro professionale. Maggioli Editore propone un corso formativo in due sessioni – tenute da Claudio Gionti e Giovanna Panucci – che affronta con taglio pratico e rigoroso proprio questo problema: Come evitare le allucinazioni dell’AI.

Con due docenti esperti e un programma ben articolato, il corso di Maggioli Editore si candida a diventare un riferimento per chi vuole usare l’AI in ambito legale senza cadere nella trappola delle allucinazioni. >>> Per info e iscrizioni <<<